在现代互联网应用架构中,服务器负载均衡是确保高可用性、扩展性和性能的关键技术,Nginx作为一款高性能的HTTP和反向代理服务器,凭借其高效的并发处理能力、灵活的配置选项和丰富的负载均衡算法,成为实现负载均衡的首选工具之一,本文将详细探讨Nginx服务器负载均衡的原理、配置方法、常见算法及实际应用场景。

Nginx负载均衡的基本原理

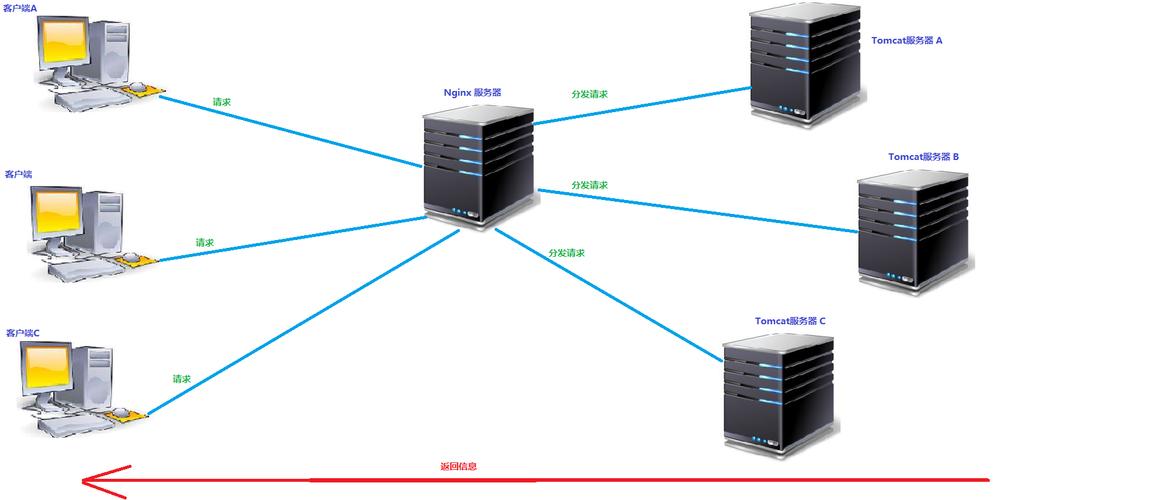

Nginx负载均衡的核心思想是通过将客户端的请求分发到多个后端服务器,避免单一服务器因过载而崩溃,从而提升整体系统的处理能力和容错能力,其工作流程通常包括:客户端请求到达Nginx服务器,Nginx根据预设的负载均衡策略选择一个后端服务器,然后将请求转发该服务器处理,最后将处理结果返回给客户端,在此过程中,Nginx作为反向代理,隐藏了后端服务器的细节,同时提供了流量分发、健康检查、会话保持等功能。

负载均衡算法及配置

Nginx支持多种负载均衡算法,可根据业务需求选择合适的策略,以下是常见的算法及其配置示例:

轮询(Round Robin)

轮询是默认的负载均衡算法,将请求按顺序依次分配到后端服务器,适用于服务器性能相近的场景,配置示例:

upstream backend {

server 192.168.1.101:80;

server 192.168.1.102:80;

server 192.168.1.103:80;

}

加权轮询(Weighted Round Robin)

通过为不同服务器分配不同的权重,实现请求分配的比例控制,适用于服务器性能差异较大的场景,配置示例:

upstream backend {

server 192.168.1.101:80 weight=3;

server 192.168.1.102:80 weight=2;

server 192.168.1.103:80 weight=1;

}

权重越高,分配到的请求越多,上述配置中,服务器101将接收50%的请求(3/6),服务器102接收33%(2/6),服务器103接收17%(1/6)。

IP哈希(IP Hash)

根据客户端IP地址的哈希值将请求分配到固定的服务器,确保同一用户的请求始终发送到同一服务器,适用于需要会话保持的场景(如购物车、登录状态),配置示例:

upstream backend {

ip_hash;

server 192.168.1.101:80;

server 192.168.1.102:80;

}

最少连接(Least Connections)

将请求分配到当前连接数最少的服务器,避免服务器过载,适用于长连接场景(如WebSocket、实时通信),配置示例:

upstream backend {

least_conn;

server 192.168.1.101:80;

server 192.168.1.102:80;

}

哈希一致性(Consistent Hashing)

基于请求的某个特征(如URL、Cookie)进行哈希分配,确保相同特征的请求路由到同一服务器,适用于缓存分片场景,配置示例:

upstream backend {

hash $request_uri consistent;

server 192.168.1.101:80;

server 192.168.1.102:80;

}

高级功能配置

健康检查

Nginx可以通过max_fails和fail_timeout参数实现后端服务器的健康检查。

upstream backend {

server 192.168.1.101:80 max_fails=3 fail_timeout=30s;

server 192.168.1.102:80 max_fails=3 fail_timeout=30s;

}

配置表示:如果某个服务器在30秒内连续3次请求失败,Nginx将暂时停止向其转发请求,直到fail_timeout时间过后重新尝试。

备用服务器

可以通过backup参数指定备用服务器,仅在所有主服务器不可用时启用:

upstream backend {

server 192.168.1.101:80;

server 192.168.1.102:80;

server 192.168.1.103:80 backup;

}

HTTPS支持

如果后端服务器使用HTTPS,可以通过proxy_pass和ssl参数配置:

server {

listen 443 ssl;

server_name example.com;

ssl_certificate /path/to/cert.pem;

ssl_certificate_key /path/to/key.pem;

location / {

proxy_pass https://backend;

proxy_set_header Host $host;

}

}

实际应用场景

- 高并发网站:通过负载均衡将流量分发到多台服务器,提升并发处理能力,电商平台在促销期间可通过Nginx将用户请求分配到多台应用服务器。

- 微服务架构:在微服务中,Nginx可作为API网关,将请求路由到不同的微服务实例,用户服务、订单服务分别部署在不同的服务器上,通过Nginx统一分发请求。

- 静态资源分离:将静态资源(如图片、CSS、JS)的请求分发到专门的静态资源服务器,减轻应用服务器的压力。

配置示例

以下是一个完整的Nginx负载均衡配置示例,包含加权轮询、健康检查和HTTPS支持:

http {

upstream backend {

server 192.168.1.101:80 weight=3 max_fails=2 fail_timeout=30s;

server 192.168.1.102:80 weight=2 max_fails=2 fail_timeout=30s;

server 192.168.1.103:80 backup;

}

server {

listen 80;

server_name example.com;

return 301 https://$host$request_uri;

}

server {

listen 443 ssl;

server_name example.com;

ssl_certificate /etc/nginx/ssl/cert.pem;

ssl_certificate_key /etc/nginx/ssl/key.pem;

location / {

proxy_pass http://backend;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

}

}

}

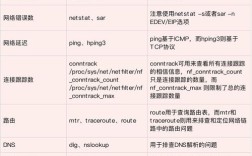

相关问答FAQs

问题1:Nginx负载均衡与反向代理的区别是什么?

解答:Nginx负载均衡和反向代理是紧密相关但功能不同的概念,反向代理是指代理服务器接收客户端请求,并将请求转发给内部服务器,然后将结果返回客户端,隐藏了内部服务器的细节,而负载均衡是反向代理的一种高级功能,通过特定的算法将请求分发到多个后端服务器,以实现流量分配和高可用性,所有负载均衡器都是反向代理,但并非所有反向代理都具备负载均衡功能。

问题2:如何实现Nginx负载均衡的会话保持?

解答:Nginx可以通过IP哈希或Cookie两种方式实现会话保持,IP哈希(ip_hash)根据客户端IP地址将请求分配到固定服务器,适用于IP稳定的场景;但如果客户端IP变化(如移动网络),会导致会话丢失,Cookie方式通过sticky模块(如nginx-sticky-module)或upstream模块的cookie参数实现,sticky cookie srv_id expires=1h domain=.example.com path=/;,这种方式将服务器标识存储在客户端Cookie中,确保后续请求路由到同一服务器,需要注意的是,Cookie方式需要额外安装模块或使用第三方解决方案。