网站没有被搜索引擎收录是许多网站运营者常遇到的问题,这种情况可能由多种因素导致,涉及网站技术、内容质量、外部链接等多个维度,以下从核心原因出发,结合具体场景和解决方案进行详细分析,帮助网站运营者系统排查问题。

技术层面:搜索引擎无法正常抓取和索引

搜索引擎的收录始于爬虫抓取,若网站存在技术障碍,爬虫无法访问或解析页面,自然无法收录,常见的技术问题包括:

-

robots.txt文件配置错误

robots.txt是爬虫访问网站的“指令文件”,若错误禁止爬虫抓取关键页面(如误用Disallow:/),会导致整站或重要页面被屏蔽,将核心内容页面路径写入Disallow,或文件存在语法错误(如未使用英文冒号、大小写混乱),都会直接阻止收录,需定期检查robots.txt语法,确保允许抓取重要目录(如Allow:/)。 -

网站无法访问或加载异常

若服务器频繁宕机、响应超时(如超过5秒),或存在404、500等错误状态码,爬虫会放弃抓取,HTTPS证书过期、IP被搜索引擎临时屏蔽(因服务器被攻击或违规操作)也会导致访问失败,可通过站长工具模拟爬虫访问,检查服务器稳定性,确保网站24小时可正常打开。 -

页面结构混乱或动态参数过多

若网站大量使用Flash、JavaScript渲染内容,而搜索引擎爬虫对JS的解析能力有限,可能导致抓取内容为空,动态URL参数过多(如?id=1&sort=2&page=3)会让爬虫误认为页面重复,降低抓取优先级,建议简化URL结构,对重要页面采用静态化处理,并通过sitemap.xml明确页面路径。 (图片来源网络,侵删)

(图片来源网络,侵删)

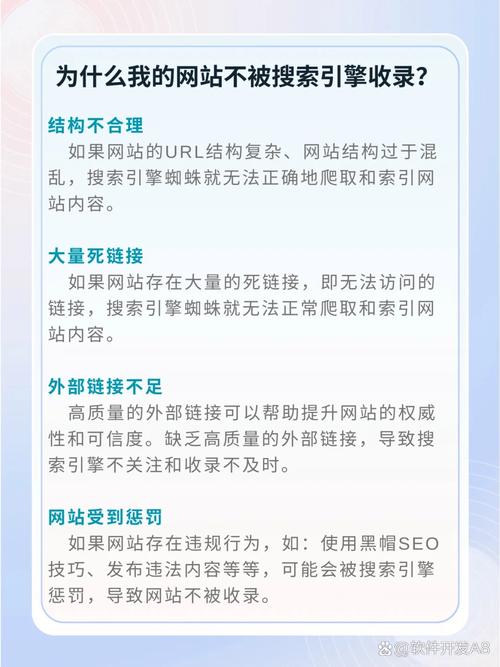

内容层面:缺乏价值或过度优化

搜索引擎的核心目标是提供优质内容,若页面内容无法满足用户需求或存在过度优化嫌疑,会被判定为低质量页面,从而不被收录,原创性不足或同质化严重**

若网站内容多为复制粘贴、或与其他网站高度相似,搜索引擎会认为其缺乏独特价值,拒绝收录,新闻类网站直接转载其他平台报道而不添加原创分析,或企业官网产品描述与竞品完全一致,都可能导致内容被过滤,需通过原创内容创作、深度行业分析提升页面独特性。

-

关键词堆砌或内容空洞

为追求排名而过度堆砌关键词(如标题、正文重复出现同一词50次以上),或页面内容仅有少量文字且与主题无关(如“欢迎访问”等无意义语句),会被判定为垃圾内容,建议关键词密度控制在2%-3%,确保内容围绕用户需求展开,每页至少有300字以上的实质性描述。 -

更新频率过低或内容过期

搜索引擎偏好活跃网站,若长期不更新内容(如超过3个月未发布新文章),或页面信息过时(如活动已结束但未更新日期),爬虫会降低抓取频率,需制定内容更新计划,定期发布与行业相关的新动态或知识。

外部因素:缺乏权威性与合规性

搜索引擎不仅评估网站自身质量,还会参考外部信号,如链接权威性和网站合规性。

-

高质量外链缺失

若网站没有其他权威站点链接(如行业媒体、政府网站推荐),搜索引擎会认为其缺乏公信力,从而降低收录优先级,可通过内容合作、客座博客等方式获取自然外链,避免购买低质量链接(如链接农场),否则可能被惩罚。 -

网站存在违规行为

若网站涉及黑帽SEO(如隐藏文字、链轮)、发布违法内容(如赌博、盗版),或被用户大量举报,会被搜索引擎惩罚,导致全站或部分页面被剔除索引,需严格遵守搜索引擎算法规则,定期检查网站是否存在违规操作。 -

新站沙盒期效应

新建网站通常需要经历“沙盒期”,即搜索引擎给予观察期,期间收录速度较慢,一般持续1-3个月,期间需持续优化技术、内容和外链,耐心等待搜索引擎评估。

排查与解决建议

针对上述问题,可按以下步骤系统排查:

- 使用站长工具提交sitemap.xml,主动告知搜索引擎页面路径;

- 检查robots.txt和服务器状态,确保爬虫可正常访问;

- 分析页面内容质量,提升原创性和用户价值;

- 定期获取高质量外链,增强网站权威性。

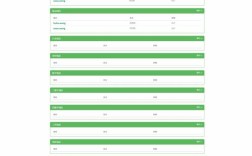

| 常见问题 | 解决方案 |

|---|---|

| robots.txt误屏蔽 | 检查语法,确保核心页面路径未被Disallow |

| 服务器频繁宕机 | 更换稳定服务器或优化CDN配置 |

| 新站无外链 | 通过行业论坛、自媒体平台发布原创内容引流 |

相关问答FAQs

Q1:网站提交sitemap后多久会被收录?

A1:通常需要1-4周,具体时间取决于网站权重和内容质量,新站可能更久,建议持续更新优质内容并配合外链建设,加速收录进程。

Q2:为什么网站首页收录了,内页却不收录?

A2:多因内页价值不足(如内容重复、关键词堆砌)或内部链接结构混乱(如内页未被首页链接),可通过优化内页内容、在首页添加相关文章链接解决,同时确保内页URL简洁规范。