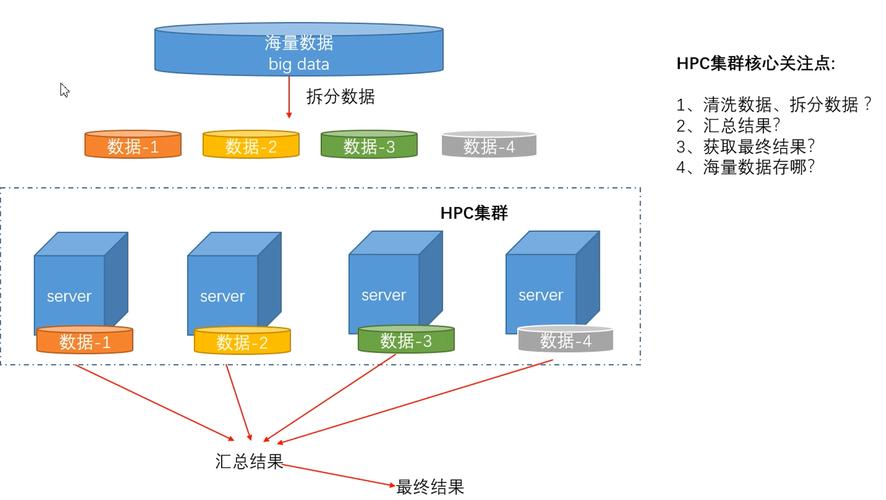

Hadoop集群服务器配置是搭建大数据处理平台的基础工作,涉及硬件选型、操作系统安装、网络配置、Hadoop组件部署及优化等多个环节,合理的配置能够确保集群的高可用、高性能和可扩展性,满足海量数据存储和计算需求,以下从核心要素出发,详细说明Hadoop集群的配置步骤和注意事项。

在硬件配置方面,Hadoop集群通常分为Master节点和Worker节点,Master节点负责NameNode、ResourceManager等核心服务的运行,对CPU、内存和磁盘I/O要求较高,建议配置16核以上CPU、64GB以上内存,并使用SSD磁盘提升元数据访问速度,Worker节点负责DataNode和NodeManager,主要关注存储容量和磁盘带宽,建议配置8-16核CPU、32-64GB内存,并配备多块HDD磁盘(通常为4-8块,单块容量4TB以上),通过RAID 0或JBOD模式提升存储性能,网络配置需确保所有节点间千兆以上带宽,Master与Worker节点间建议使用万兆网络,并划分独立VLAN隔离数据流量与管理流量。

操作系统推荐使用Linux(如CentOS 7+或Ubuntu 18.04+),需关闭防火墙和SELinux,配置/etc/hosts文件实现节点间主机名解析,并配置SSH免密登录(Master节点免密登录所有Worker节点),Java环境是Hadoop运行的基础,需安装JDK 1.8或更高版本,并配置JAVA_HOME环境变量,Hadoop版本选择需结合业务需求,推荐稳定的3.x系列,下载后解压至/opt/hadoop目录,并配置HADOOP_HOME环境变量。

Hadoop核心配置文件位于$HADOOP_HOME/etc/hadoop目录,需重点修改以下文件:core-site.xml配置NameNode地址和临时目录,如fs.defaultFS设置为hdfs://master:9000,hadoop.tmp.dir指定本地临时路径;hdfs-site.xml配置副本数(dfs.replication通常为3)、DataNode数据存储目录(dfs.datanode.data.dir)及NameNode元数据存储目录(dfs.namenode.name.dir);mapred-site.xml配置MapReduce框架为YARN(mapreduce.framework.name=yarn);yarn-site.xml配置ResourceManager地址(yarn.resourcemanager.hostname)、NodeManager资源管理参数(如yarn.nodemanager.resource.memory-mb)及日志聚合功能;workers文件列出所有Worker节点主机名,用于集群启动时分发节点信息。

集群启动与测试需按顺序执行:首先格式化NameNode(hdfs namenode -format),然后启动HDFS(start-dfs.sh)和YARN(start-yarn.sh),通过jps命令验证各节点进程(Master节点应有NameNode、ResourceManager,Worker节点应有DataNode、NodeManager),使用hdfs dfs -mkdir /test创建测试目录,上传文件(hdfs dfs -put local.txt /test)并运行MapReduce示例(hadoop jar hadoop-mapreduce-examples.jar wordcount /test /output),验证计算结果,需配置集群监控(如Prometheus+Grafana)和日志收集(如ELK),以及定期备份NameNode元数据和DataNode数据,确保集群稳定性。

相关问答FAQs

-

问:Hadoop集群中NameNode的高可用如何配置?

答:NameNode高需通过HDFS HA机制实现,主要步骤包括:①配置两个Active/Standby NameNode节点,使用ZooKeeper实现故障自动切换;②配置JournalNode节点同步元数据;③在core-site.xml中设置dfs.nameservices、dfs.ha.namenodes和dfs.namenode.rpc-address等参数;④启用HA自动故障转移(dfs.ha.automatic-failover.enabled=true),需确保ZooKeeper集群正常运行,并配置好SSH免密登录和共享存储(如QJM)。 -

问:Worker节点磁盘空间不足时如何处理?

答:处理步骤包括:①监控磁盘使用率(如通过df命令或监控工具),设置告警阈值(如80%);②清理临时文件或无用数据(如HDFS回收站配置fs.trash.interval调整清理周期);③扩容磁盘:对于物理机,可添加新磁盘并格式化挂载至HDFS数据目录;对于虚拟机,需扩容磁盘后通过操作系统命令扩展分区;④动态调整DataNode存储策略,如使用hdfs dfsadmin -report查看节点状态,均衡数据分布(hadoop balancer -threshold 10),若磁盘持续不足,需考虑增加Worker节点分担存储压力。